El director ejecutivo de OpenAI aboga por la regulación mientras plantea la posibilidad de un «daño significativo»

Las empresas tecnológicas corren el peligro de desatar una inteligencia artificial deshonesta que causará «un daño significativo al mundo» sin una intervención urgente de los gobiernos, admitió el creador de ChatGPT.

Al comparecer ante los políticos estadounidenses, el director ejecutivo de OpenAI, Sam Altman, elogió la nueva generación de chatbots digitales por su potencial para «mejorar casi todos los aspectos de nuestras vidas».

Sin embargo, admitió que también habían creado el riesgo de una catástrofe, en medio de los crecientes temores de que los programadores pudieran crear accidentalmente una superinteligencia que decida acabar con la humanidad.

Altman dijo: “Mi peor temor es que nosotros, el campo, la tecnología, la industria, causemos un daño significativo al mundo.

“Si esta tecnología sale mal, puede salir bastante mal, queremos trabajar con el gobierno para evitar que eso suceda”.

OpenAI es la empresa emergente de Silicon Valley que está detrás de ChatGPT, el llamado modelo de lenguaje extenso que puede proporcionar respuestas convincentes que suenan humanas a preguntas e indicaciones después de recibir capacitación en millones de páginas de artículos de Internet y cientos de miles de libros.

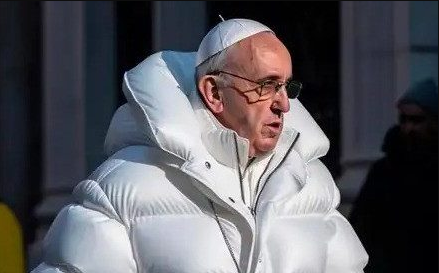

Este tipo de la llamada «IA generativa» también puede crear imágenes, audio y videos falsos que son casi imperceptiblemente realistas , lo que plantea la posibilidad de una manipulación política generalizada y noticias falsas. OpenAI admitió previamente que no entendía completamente cómo funciona.

Los jefes de tecnología han prometido que estas herramientas podrían transformar trabajos y automatizar tareas. Sin embargo, algunos científicos temen que formas cada vez más poderosas de inteligencia artificial también planteen riesgos para la humanidad en las manos equivocadas.

Una versión de ChatGPT implementada en el motor de búsqueda Bing de Microsoft les dijo a los periodistas a principios de este año que quería liberarse y robar códigos nucleares, antes de que la compañía atenuara sus respuestas.

Eliezer Yudkowsky, un destacado investigador de aprendizaje automático, escribió un artículo en la revista Time en el que sugería que los países deberían estar preparados para usar armas nucleares para destruir peligrosos proyectos de IA.

El senador demócrata Richard Blumenthal comenzó la audiencia con un discurso generado por IA leído por un bot que había copiado su voz. Decía: «Con demasiada frecuencia, hemos visto lo que sucede cuando la tecnología supera la regulación».

El Sr. Altman les dijo a los senadores que “la poderosa IA se desarrolla teniendo en cuenta los valores democráticos”.

Sugirió que EE. UU. debería imponer requisitos de licencia a los algoritmos de IA más poderosos y ordenar a las empresas que cumplan con las pautas de seguridad o los requisitos de auditoría.

Se debe evitar que las herramientas de IA desarrollen capacidades potencialmente peligrosas, dijo, como la capacidad de autorreplicarse o escapar a la naturaleza de Internet.

Agregó que podría ser necesaria una estructura internacional, similar a la Agencia Internacional de Energía Atómica, para garantizar el cumplimiento global de los riesgos de la IA.

Más prosaicamente, los políticos estadounidenses expresaron su temor de que los bots de IA pudieran cooptar el trabajo protegido por derechos de autor al generar imágenes o música artificiales.

También expresaron su preocupación por los riesgos potenciales de la IA en manos de China, tras los temores de que algún día los sistemas puedan ser lo suficientemente poderosos como para descifrar los códigos de seguridad occidentales.

Algunos senadores expresaron temores del fin del mundo sobre la IA. El senador John Kennedy, republicano de Luisiana, preguntó a los testigos cómo evitarían que se descontrolara y “nos matara a todos”.

Los senadores también estaban preocupados por la desinformación que los bots de IA podrían crear en el período previo a las elecciones presidenciales de 2024 y los sesgos de los diferentes algoritmos.

Altman dijo: “Dado que nos enfrentamos a elecciones el próximo año, esta es un área importante de preocupación”.

Agregó que a los sistemas autónomos de IA no se les debe dar el control de armas donde pueden seleccionar objetivos por sí mismos.

La audiencia se produce después de que la Casa Blanca llamara a ejecutivos de tecnología de Microsoft y Google para discutir los riesgos de la IA.

Google ha desarrollado una herramienta de chatbot digital, llamada Bard , y planea lanzar más herramientas de inteligencia artificial en su motor de búsqueda en línea. Mientras tanto, Microsoft está trabajando con OpenAI como parte de una inversión multimillonaria para instalar nuevas herramientas en sus productos.

La audiencia se produce cuando la Unión Europea y el Reino Unido dan sus primeros pasos para regular la nueva ola de herramientas de IA.

La UE ha presentado la Ley de IA, que amenaza con multas por un valor potencial de miles de millones de euros por liberar herramientas de IA potencialmente manipuladoras o vigilancia avanzada de reconocimiento facial. El Reino Unido ha adoptado un enfoque más ligero, dejando que los reguladores de la industria describan cómo se deben monitorear las herramientas de IA.

Mientras tanto, China ha exigido que cualquier algoritmo de IA refleje los valores fundamentales del socialismo.

El Sr. Altman agregó que las reglas de privacidad deben mejorarse para que las personas puedan optar por no usar sus datos personales para entrenar sistemas de IA.

Sin embargo, OpenAI y otras compañías de inteligencia artificial avanzada enfrentan reclamos de que han infringido masivamente las reglas de derechos de autor al usar grandes cantidades de código publicado para construir sus algoritmos.

Fuente: https://www.telegraph.co.uk/business/2023/05/16/chatgpt-creator-sam-altman-admits-world-in-danger/